Menu

close

❗ Triggerwarnung: Diese Seite thematisiert digitale sexualisierte Gewalt.

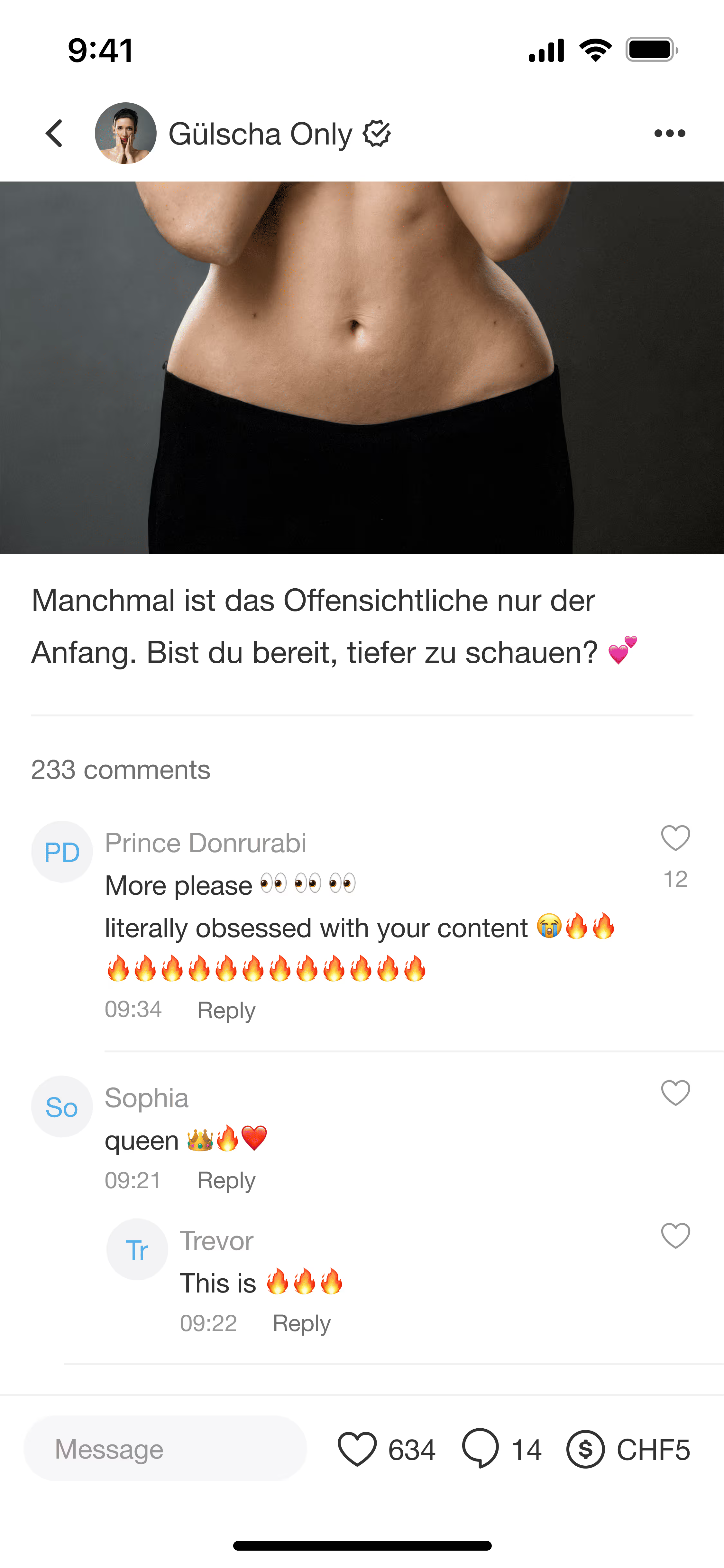

Stell dir vor: Du entdeckst Gülsha Adilji (oder dich selbst!) auf einer Plattform wie OnlyFans. Das Gesicht vertraut, doch kein einziges Bild ist echt.

Mit diesem täuschend echten Mock-up-Account zeigen wir, was tagtäglich im Netz passiert – oft ohne Wissen der Betroffenen. Wir möchten verdeutlichen, wie einfach sich heute intime Deepfakes erstellen lassen und wie schnell dadurch Ruf, Privatsphäre und Sicherheitsgefühl zerstört werden können. Gleichzeitig stellen wir Schutzmöglichkeiten vor.

Die Obenohne-Fotos wurden von KI-Künstler Basil Stücheli mit künstlicher Intelligenz generiert.

Hier zeigt Basil, wie aus dem Originalbild aus dem Ringier Archiv von Geri Born ein täuschend echtes Fake-Foto entsteht:

Ein drittel aller Jugendlichen hatte bereits Kontakt mit sextortionähnlichen Inhalten.

(Quelle: clickandstop.ch, 2024, CH-Kontext)

80 % der Betroffenen melden sich nicht aus Angst/Scham.

(Quelle: Europol, IOCTA 2023, EU-Kontext)

KI erstellt aus einem Selfie täuschend echte Fake-Nacktbilder.

(Quelle: Sensity AI, 2023, „State of Deepfakes“)

98 % aller Deepfake-Videos im Internet sind pornographisch

(Quelle: Sensity AI, 2023, „State of Deepfakes“)

Willkommen bei WHAT THE FAKE – lerne, wie du dich schützt auf clickandstop.ch.

In Kooperation mit Kinderschutz Schweiz & clickandstop.ch

Wichtiger Hinweis: Kampagnen-Inszenierung · kein echter Account.

Die Kampagne wird unterstützt von Kinderschutz Schweiz und Ringier. Gülsha Adilji ist informiert und steht hinter der Aktion.